El Consejo de Ministros aprobó el Anteproyecto de Ley para el buen uso y la gobernanza de la Inteligencia Artificial en el que se definen las obligaciones de la comunidad española con relación al uso, recolección de datos, el etiquetado y difusión o comercialización de imágenes, audios o productos con IA.

Este es un resumen de las prohibiciones y sanciones que se pretenden aplicar para evitar los riesgos de un mal uso de la Inteligencia Artificial y las entidades encargadas del control. Las nuevas normas se adaptan al reglamento europeo de IA.

El Anteproyecto de Ley, se encuentra en vía de «trámites preceptivos antes de volver al Consejo de Ministros para su aprobación definitiva como Proyecto de Ley» y envío a las Cortes Generales para su aprobación, y según el Consejo de Ministros, se tramitará por la vía de urgencia.

En particular, se prohíben determinados usos maliciosos de la IA e introduce obligaciones «más rigurosas para sistemas considerados de alto riesgo», además de establecer requisitos de transparencia para el resto.

Esto permitirá a la autoridad de vigilancia competente, el retiro del mercado español de los productos o elementos que resulten sancionados por infracciones graves.

Se trata de «un nuevo derecho digital de retirada provisional del mercado español de sistemas de IA por la autoridad de vigilancia competente cuando hayan provocado un incidente grave».

¿Desde cuándo se aplicarán las sanciones?

Siempre ajustado a lo que fije el reglamento europeo, desde el 2 de agosto de 2025 se podrán sancionar mediante multas u otras medidas adicionales, todas las prácticas prohibidas que entraron en vigor el 2 de febrero de 2025.

¿Quienes controlan o sancionan?

Una de las autoridades encargadas de vigilar los sistemas prohibidos es la Junta Electoral Central, que en particular se encargará de «los sistemas de IA que afecten a los procesos democráticos».

También está la Agencia Española de Protección de Datos, para controlar los sistemas biométricos y la gestión de fronteras.

El nuevo reglamento asigna además al Consejo General del Poder Judicial como encargados de vigilar los sistemas de IA en el ámbito de la justicia, y a la Agencia Española de Supervisión de la Inteligencia Artificial para los sistemas de IA en general.

Prohibiciones en el ámbito político y en las clasificaciones inteligentes

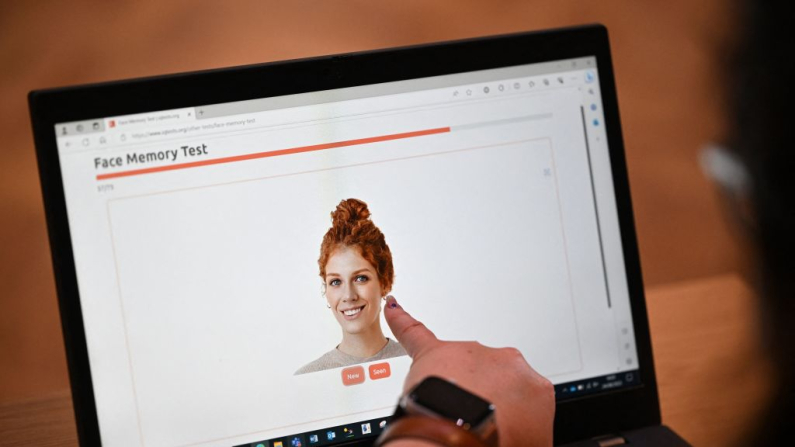

El reglamento presentado en el anteproyecto, prohíbe toda clasificación biométrica de las personas por raza u orientación política, religiosa o sexual.

También estará prohibido un «sistema de categorización facial biométrica capaz de deducir la orientación política o sexual de un individuo mediante análisis de sus fotos en redes sociales».

Tampoco se puede asignar «puntuación de individuos o grupos basándose en comportamientos sociales o rasgos personales como método de selección». Como ejemplo, se cita que podría usarse «para denegarles la concesión de subvenciones o préstamos».

Usar la IA para valorar el riesgo de que una persona cometa un delito, basándose en datos personales, también está prohibido. Esto incluye su historial familiar, nivel educativo o lugar de residencia. Sin embargo, hay excepciones legales.

El ministro para la Transformación Digital y de la Función Pública, Óscar López, destacó que las autoridades tendrán derecho de acceso en «todos aquellos que tengan que ver con terrorismo, trata de seres humanos, explotación sexual de menores, tráfico ilícito de estupefacientes, tráfico ilícito de armas (…) asuntos que afecten a la seguridad, asuntos que afecten a la defensa o asuntos de policía o judiciales, donde, obviamente, el sistema biométrico sea de utilidad para identificar a un culpable o a quien ha cometido un delito o para prevenir un atentado».

«Esos son los casos en los que queda excepcionado. Pero para todo lo demás, obviamente, cualquier uso, entiéndame, correcto, civil, queda prohibido por el reglamento europeo los sistemas biométricos de identificación», por lo que menciona que «está prohibido el uso de la biometría en espacios públicos donde a usted le pueden estar grabando sin autorización con cualquier us».

Infracciones graves al no etiquetado correcto de imágenes

El nuevo reglamento establecerá que «como una infracción grave no cumplir con la obligación de etiquetar correctamente cualquier imagen, audio o vídeo generado o manipulado con IA».

Para estos caso el texto precisa «que muestren a personas reales o inexistentes diciendo o haciendo cosas que nunca han hecho o en lugares donde nunca han estado, lo que constituye una ultrasuplantación (deepfake)».

El reglamento prevé la obligación de identificar estos contenidos como generados por IA «de manera clara y distinguible a más tardar con ocasión de la primera interacción o exposición», tal y como especifica el reglamento europeo.

Prohibición de «manipular decisiones sin consentimiento» y explotar vulnerabilidades

Los consejos encargados en controlar y sancionar considerarán prohibidos el uso de técnicas subliminales, que usan imágenes o sonidos imperceptibles, para «manipular decisiones sin consentimiento, causando un perjuicio considerable a la persona», como es el caso de adicciones, violencia de género o menoscabo de su autonomía.

No queda claro cómo se establecería un presunto consentimiento.

El Consejo de Ministros citó el ejemplo de un chatbot con capacidad para identificar usuarios con adicción al juego, que luego se aprovecha de esta vulnerabilidad «y les incita a entrar, con técnicas subliminales, en una plataforma de juego online».

Quedan prohibidas todas las posibles explotaciones de «vulnerabilidades relacionadas con la edad, la discapacidad o situación socioeconómica para alterar sustancialmente comportamientos de modo que les provoque o pueda provocar perjuicios considerables».

El resumen cita como ejemplo un juguete infantil habilitado con IA que sea capaz de animar a los niños a completar retos, pero que estos retos les produzcan o puedan producirles daños físicos graves.

Queda prohibido deducir o «inferir emociones en centros de trabajo o educativos como método de evaluación para promoción o despido laboral, salvo por razones médicas o de seguridad».

Infracciones graves

Una infracción es grave cuando se incumplan las órdenes de una autoridad de vigilancia de mercado, o cuando un operador de un sistema de IA no comunique un incidente grave de muerte de una persona, daño que haya comprometido una infraestructura crítica, o daño al medio ambiente, o

Las sanciones en este caso, oscilarán entre los 7,5 y los 15 millones de euros o hasta el 2% y el 3% del volumen de negocio mundial del ejercicio anterior.

Será considerado grave el no introducir supervisión humana en un sistema de IA que incorpore la biometría en el trabajo para controlar la presencialidad de los trabajadores.

También se prevé como grave el no disponer de un sistema de gestión de calidad en robots con IA que desarrollan las tareas de inspección y mantenimiento en sectores industriales, entre otros.

Las sanciones oscilarán en estos casos entre 500.000 euros y 7,5 millones de euros o entre el 1% y el 2% del volumen de negocio mundial.

Otra infracción grave es no cumplir con la obligación de etiquetar correctamente cualquier imagen, audio o vídeo generado o manipulado con IA.

Infracciones leves

Se considerarán infracciones leves que un sistema de IA de alto riesgo no incorpore el marcado CE que es obligatorio en la comunidad europea, o, cuando no sea posible, en su embalaje o en la documentación que lo acompañe, para indicar la conformidad con el Reglamento de IA.

Otras entidades encargadas del monitoreo

Además de las autoridades encargadas de vigilar los sistemas de alto riesgo, la Agencia Española de Protección de Datos, tendrá competencia en los sistemas de gestión de migraciones y asilo asociados a las Fuerzas y Cuerpos de Seguridad del Estado.

A su vez, los sistemas de IA en la administración de justicia y la Junta Electoral Central, se encargarán de los sistemas de procesos electorales.

Por su parte, el Banco de España controlará sistemas de clasificación de solvencia crediticia; la Dirección General de Seguros, los sistemas de seguros; y la CNMV, los sistemas de mercados de capitales.

En el resto de los casos, la autoridad competente será la AESIA.

Sistemas de alto riesgo

El reglamento considera a una lista de elementos como sistemas de IA de alto riesgo, lo que conlleva a que cumplan una serie de obligaciones, «como disponer de un sistema de gestión de riesgos y de supervisión humana, documentación técnica, una gobernanza de datos, conservación de registros, transparencia y comunicación de información a los responsables del despliegue, sistema de calidad, etc..

Estos son los elementos considerados de alto riesgo:

Todos los que puedan añadirse como elementos de seguridad a productos industriales (máquinas, ascensores, sistemas de protección-EPIS, equipos a presión o aparatos a gas), juguetes, equipos radioeléctricos, productos sanitarios incluyendo diagnósticos in vitro, productos de transportes (aviación, ferrocarril, equipos marinos y vehículos a motor de 2 y 3 ruedas y agrícolas, embarcaciones y transporte por cable).

Sistemas que formen parte de los siguientes ámbitos: biometría, infraestructuras críticas, educación y formación profesional, empleo, acceso a servicios privados esenciales (como servicios crediticios o de seguros) y a servicios y prestaciones públicos esenciales (como servicios de emergencias o triajes) y disfrute de estos servicios y prestaciones.

Sistemas para la garantía del derecho, migración, asilo y gestión del control fronterizo.

Sistemas para su uso en la administración de justicia y en procesos democráticos.

Sandbox de IA

A partir del 2 de agosto de 2026, el reglamento europeo obliga a los países miembros a establecer al menos un sandbox de IA, para un entorno controlado de pruebas para la validación de sistemas innovadores de IA durante un tiempo limitado antes de su comercialización o puesta en servicio, y de manera acordada entre los proveedores o posibles proveedores y la autoridad competente.

España lanzó en diciembre pasado una convocatoria para seleccionar hasta un total de 12 sistemas de IA de alto riesgo que, durante un año, participarán en un entorno controlado de pruebas.

«La experiencia acumulada y las lecciones aprendidas servirán para publicar unas guías técnicas sobre el cumplimiento de los requisitos aplicables a los sistemas de alto riesgo.

Cómo puede usted ayudarnos a seguir informando

¿Por qué necesitamos su ayuda para financiar nuestra cobertura informativa en España y en todo el mundo? Porque somos una organización de noticias independiente, libre de la influencia de cualquier gobierno, corporación o partido político. Desde el día que empezamos, hemos enfrentado presiones para silenciarnos, sobre todo del Partido Comunista Chino. Pero no nos doblegaremos. Dependemos de su generosa contribución para seguir ejerciendo un periodismo tradicional. Juntos, podemos seguir difundiendo la verdad.